Durch die Fundierung mit

Die Fundierung mit

- Faktische Richtigkeit erhöhen: Reduzieren Sie Modellhalluzinationen, indem Sie Antworten auf realen Informationen basieren.

- Auf Echtzeitinformationen zugreifen: Fragen zu aktuellen Ereignissen und Themen beantworten

- Quellen angeben: Sie können das Vertrauen der Nutzer stärken oder ihnen ermöglichen, relevante Websites aufzurufen, indem Sie die Quellen für die Behauptungen des Modells angeben.

- Komplexere Aufgaben erledigen: Artefakte und relevante Bilder, Videos oder andere Medien abrufen, um bei logischen Aufgaben zu helfen.

- Regionen- oder sprachspezifische Antworten verbessern: Regionenspezifische Informationen finden oder bei der genauen Übersetzung von Inhalten helfen.

Unterstützte Modelle

gemini-3.1-pro-previewgemini-3-flash-previewgemini-3.1-flash-litegemini-3-pro-image-preview(auch „Nano Banana Pro“ genannt)gemini-3.1-flash-image-preview(auch „Nano Banana 2“)gemini-2.5-progemini-2.5-flashgemini-2.5-flash-lite

Unterstützte Sprachen

Unterstützte Sprachen für Gemini-Modelle

Modell mit Google Search fundieren

|

Klicken Sie auf Ihren Gemini API-Anbieter, um anbieterspezifische Inhalte und Code auf dieser Seite aufzurufen. |

Wenn Sie die GenerativeModel-Instanz erstellen, geben Sie GoogleSearch als tool an, das das Modell zum Generieren der Antwort verwenden kann.

Swift

import FirebaseAILogic

// Initialize the Gemini Developer API backend service

let ai = FirebaseAI.firebaseAI(backend: .googleAI())

// Create a `GenerativeModel` instance with a model that supports your use case

let model = ai.generativeModel(

modelName: "GEMINI_MODEL_NAME",

// Provide Google Search as a tool that the model can use to generate its response

tools: [Tool.googleSearch()]

)

let response = try await model.generateContent("Who won the euro 2024?")

print(response.text ?? "No text in response.")

// Make sure to comply with the "Grounding with Google Search" usage requirements,

// which includes how you use and display the grounded result

Kotlin

// Initialize the Gemini Developer API backend service

// Create a `GenerativeModel` instance with a model that supports your use case

val model = Firebase.ai(backend = GenerativeBackend.googleAI()).generativeModel(

modelName = "GEMINI_MODEL_NAME",

// Provide Google Search as a tool that the model can use to generate its response

tools = listOf(Tool.googleSearch())

)

val response = model.generateContent("Who won the euro 2024?")

print(response.text)

// Make sure to comply with the "Grounding with Google Search" usage requirements,

// which includes how you use and display the grounded result

Java

// Initialize the Gemini Developer API backend service

// Create a `GenerativeModel` instance with a model that supports your use case

GenerativeModel ai = FirebaseAI.getInstance(GenerativeBackend.googleAI())

.generativeModel("GEMINI_MODEL_NAME",

null,

null,

// Provide Google Search as a tool that the model can use to generate its response

List.of(Tool.GoogleSearch()));

// Use the GenerativeModelFutures Java compatibility layer which offers

// support for ListenableFuture and Publisher APIs

GenerativeModelFutures model = GenerativeModelFutures.from(ai);

ListenableFuture response = model.generateContent("Who won the euro 2024?");

Futures.addCallback(response, new FutureCallback() {

@Override

public void onSuccess(GenerateContentResponse result) {

String resultText = result.getText();

System.out.println(resultText);

}

@Override

public void onFailure(Throwable t) {

t.printStackTrace();

}

}, executor);

// Make sure to comply with the "Grounding with Google Search" usage requirements,

// which includes how you use and display the grounded result

Web

import { initializeApp } from "firebase/app";

import { getAI, getGenerativeModel, GoogleAIBackend } from "firebase/ai";

// TODO(developer) Replace the following with your app's Firebase configuration

// See: https://firebase.google.com/docs/web/learn-more#config-object

const firebaseConfig = {

// ...

};

// Initialize FirebaseApp

const firebaseApp = initializeApp(firebaseConfig);

// Initialize the Gemini Developer API backend service

const ai = getAI(firebaseApp, { backend: new GoogleAIBackend() });

// Create a `GenerativeModel` instance with a model that supports your use case

const model = getGenerativeModel(

ai,

{

model: "GEMINI_MODEL_NAME",

// Provide Google Search as a tool that the model can use to generate its response

tools: [{ googleSearch: {} }]

}

);

const result = await model.generateContent("Who won the euro 2024?");

console.log(result.response.text());

// Make sure to comply with the "Grounding with Google Search" usage requirements,

// which includes how you use and display the grounded result

Dart

import 'package:firebase_core/firebase_core.dart';

import 'package:firebase_ai/firebase_ai.dart';

import 'firebase_options.dart';

// Initialize FirebaseApp

await Firebase.initializeApp(

options: DefaultFirebaseOptions.currentPlatform,

);

// Initialize the Gemini Developer API backend service

// Create a `GenerativeModel` instance with a model that supports your use case

final model = FirebaseAI.googleAI().generativeModel(

model: 'GEMINI_MODEL_NAME',

// Provide Google Search as a tool that the model can use to generate its response

tools: [

Tool.googleSearch(),

],

);

final response = await model.generateContent([Content.text("Who won the euro 2024?")]);

print(response.text);

// Make sure to comply with the "Grounding with Google Search" usage requirements,

// which includes how you use and display the grounded result

Einheit

using Firebase;

using Firebase.AI;

// Initialize the Gemini Developer API backend service

var ai = FirebaseAI.GetInstance(FirebaseAI.Backend.GoogleAI());

// Create a `GenerativeModel` instance with a model that supports your use case

var model = ai.GetGenerativeModel(

modelName: "GEMINI_MODEL_NAME",

// Provide Google Search as a tool that the model can use to generate its response

tools: new[] { new Tool(new GoogleSearch()) }

);

var response = await model.GenerateContentAsync("Who won the euro 2024?");

UnityEngine.Debug.Log(response.Text ?? "No text in response.");

// Make sure to comply with the "Grounding with Google Search" usage requirements,

// which includes how you use and display the grounded result

Hier erfahren Sie, wie Sie ein Modell auswählen, der für Ihren Anwendungsfall und Ihre App geeignet ist.

Die besten Ergebnisse erzielen Sie mit einer Temperatur von 1.0 (dem Standardwert für alle 2.5-Modelle). Informationen zum Festlegen der Temperatur in der Modellkonfiguration

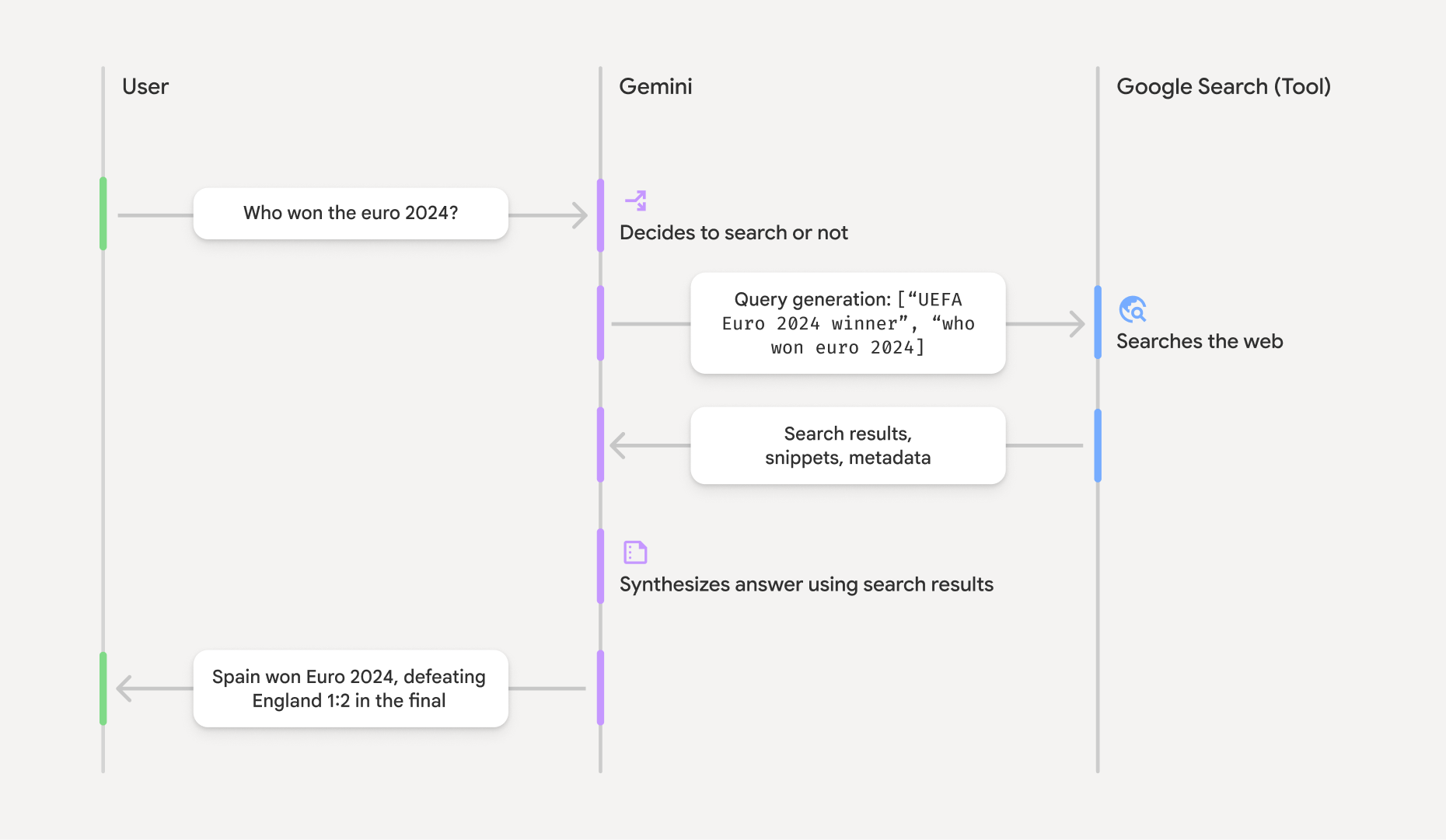

So funktioniert die Fundierung mit Google Search

Wenn Sie das GoogleSearch-Tool verwenden, übernimmt das Modell den gesamten Workflow für die automatische Suche, Verarbeitung und Quellenangabe von Informationen.

So funktioniert das Modell:

- Prompt empfangen: Ihre App sendet einen Prompt an das Gemini-Modell, wobei das

GoogleSearch-Tool aktiviert ist. - Prompt analysieren: Das Modell analysiert den Prompt und ermittelt, ob

Google Search die Antwort verbessern kann. - Anfragen an

Google Search senden: Bei Bedarf generiert das Modell automatisch eine oder mehrere Suchanfragen und führt sie aus. - Suchergebnisse verarbeiten: Das Modell verarbeitet die

Google Search -Ergebnisse und formuliert eine Antwort auf den ursprünglichen Prompt. - Fundiertes Ergebnis zurückgeben: Das Modell gibt eine endgültige, nutzerfreundliche Antwort zurück, die auf den

Google Search -Ergebnissen basiert. Diese Antwort enthält die Textantwort des Modells undgroundingMetadatamit den Suchanfragen, Webergebnissen und Quellen.

Beachten Sie, dass die Bereitstellung von groundingMetadata-Objekt und ist daher kein „fundiertes Ergebnis“.

Fundiertes Ergebnis verstehen

Wenn das Modell seine Antwort auf groundingMetadata-Objekt mit strukturierten Daten, die für die Überprüfung von Behauptungen und die Erstellung einer umfassenden Quellenübersicht in Ihrer Anwendung unerlässlich sind.

Das groundingMetadata-Objekt in einem fundierten Ergebnis enthält die folgenden Informationen:

webSearchQueries: Ein Array der Suchanfragen, die anGoogle Search gesendet wurden. Diese Informationen sind nützlich für das Debugging und um den Denkprozess des Modells nachzuvollziehen.searchEntryPoint: Enthält den HTML- und CSS-Code zum Rendern der erforderlichen „Google Search -Vorschläge“. Sie müssen die Nutzungsanforderungen für die Fundierung mitGoogle Search für den von Ihnen ausgewählten API-Anbieter einhalten: Gemini Developer API oder Vertex AI Gemini API (siehe Abschnitt Nutzungsbedingungen in den dienstspezifischen Nutzungsbedingungen). Informationen zum Verwenden und Anzeigen eines fundierten Ergebnisses finden Sie weiter unten auf dieser Seite.groundingChunks: Ein Array von Objekten, das die Webquellen (uriundtitle) enthält.groundingSupports: Ein Array von Blöcken, um die Modellantworttextmit den Quellen ingroundingChunkszu verknüpfen. Jeder Chunk verknüpft einen Text-segment(definiert durchstartIndexundendIndex) mit einem oder mehrerengroundingChunkIndices. Mit diesem Feld können Sie Inline-Quellenlinks erstellen. Informationen zum Verwenden und Anzeigen eines fundierten Ergebnisses finden Sie weiter unten auf dieser Seite.

Hier sehen Sie ein Beispiel für eine Antwort, die ein groundingMetadata-Objekt enthält:

{

"candidates": [

{

"content": {

"parts": [

{

"text": "Spain won Euro 2024, defeating England 2-1 in the final. This victory marks Spain's record fourth European Championship title."

}

],

"role": "model"

},

"groundingMetadata": {

"webSearchQueries": [

"UEFA Euro 2024 winner",

"who won euro 2024"

],

"searchEntryPoint": {

"renderedContent": "<!-- HTML and CSS for the search widget -->"

},

"groundingChunks": [

{"web": {"uri": "https://vertexaisearch.cloud.google.com.....", "title": "aljazeera.com"}},

{"web": {"uri": "https://vertexaisearch.cloud.google.com.....", "title": "uefa.com"}}

],

"groundingSupports": [

{

"segment": {"startIndex": 0, "endIndex": 85, "text": "Spain won Euro 2024, defeatin..."},

"groundingChunkIndices": [0]

},

{

"segment": {"startIndex": 86, "endIndex": 210, "text": "This victory marks Spain's..."},

"groundingChunkIndices": [0, 1]

}

]

}

}

]

}

Fundiertes Ergebnis verwenden und anzeigen

Wenn das Modell das Tool groundingMetadata-Objekt bereitgestellt.

Es ist erforderlich,

Die Anzeige dieser Informationen hilft Ihnen und Ihren Endnutzern, Antworten zu validieren, und bietet Möglichkeiten zum weiteren Lernen.

(Erforderlich) Google Search -Vorschläge anzeigen

Wenn eine Antwort „

Das groundingMetadata-Objekt enthält „searchEntryPoint, das ein Feld renderedContent mit konformen HTML- und CSS-Stilen enthält. Diese müssen Sie implementieren, um Suchvorschläge in Ihrer App anzuzeigen.

Ausführliche Informationen zu den Anzeige- und Verhaltensanforderungen für

Beispielcode finden Sie weiter unten in diesem Abschnitt.

(Erforderlich) Displayquellen

Das groundingMetadata-Objekt enthält strukturierte Quelldaten, insbesondere die Felder groundingSupports und groundingChunks. Anhand dieser Informationen können Sie die Aussagen des Modells direkt mit den Quellen in Ihrer Benutzeroberfläche verknüpfen (inline und aggregiert).

Beispielcode finden Sie weiter unten in diesem Abschnitt.

Beispielcode

Diese Codebeispiele enthalten verallgemeinerte Muster für die Verwendung und Anzeige des fundierten Ergebnisses. Sie sind jedoch dafür verantwortlich, dass Ihre spezifische Implementierung den Compliance-Anforderungen entspricht.

Swift

// ...

// Get the model's response

let text = response.text

// Get the grounding metadata

if let candidate = response.candidates.first,

let groundingMetadata = candidate.groundingMetadata {

// REQUIRED - display Google Search suggestions

// (renderedContent contains HTML and CSS for the search widget)

if let renderedContent = groundingMetadata.searchEntryPoint?.renderedContent {

// TODO(developer): Display Google Search suggestions using a WebView

}

// REQUIRED - display sources

let groundingChunks = groundingMetadata.groundingChunks

for chunk in groundingMetadata.groundingChunks {

if let web = chunk.web {

let title = web.title // for example, "uefa.com"

let uri = web.uri // for example, "https://vertexaisearch.cloud.google.com..."

// TODO(developer): show source in the UI

}

}

}

Kotlin

// ...

// Get the model's response

val text = response.text

// Get the grounding metadata

val groundingMetadata = response.candidates.firstOrNull()?.groundingMetadata

// REQUIRED - display Google Search suggestions

// (renderedContent contains HTML and CSS for the search widget)

val renderedContent = groundingMetadata?.searchEntryPoint?.renderedContent

if (renderedContent != null) {

// TODO(developer): Display Google Search suggestions using a WebView

}

// REQUIRED - display sources

val groundingChunks = groundingMetadata?.groundingChunks

groundingChunks?.let { chunks ->

for (chunk in chunks) {

val title = chunk.web?.title // for example, "uefa.com"

val uri = chunk.web?.uri // for example, "https://vertexaisearch.cloud.google.com..."

// TODO(developer): show source in the UI

}

}

Java

// ...

Futures.addCallback(response, new FutureCallback() {

@Override

public void onSuccess(GenerateContentResponse result) {

// Get the model's response

String text = result.getText();

// Get the grounding metadata

GroundingMetadata groundingMetadata =

result.getCandidates()[0].getGroundingMetadata();

if (groundingMetadata != null) {

// REQUIRED - display Google Search suggestions

// (renderedContent contains HTML and CSS for the search widget)

String renderedContent =

groundingMetadata.getSearchEntryPoint().getRenderedContent();

if (renderedContent != null) {

// TODO(developer): Display Google Search suggestions using a WebView

}

// REQUIRED - display sources

List chunks = groundingMetadata.getGroundingChunks();

if (chunks != null) {

for(GroundingChunk chunk : chunks) {

WebGroundingChunk web = chunk.getWeb();

if (web != null) {

String title = web.getTitle(); // for example, "uefa.com"

String uri = web.getUri(); // for example, "https://vertexaisearch.cloud.google.com..."

// TODO(developer): show sources in the UI

}

}

}

}

}

@Override

public void onFailure(Throwable t) {

t.printStackTrace();

}

}, executor);

Web

// ...

// Get the model's text response

const text = result.response.text();

// Get the grounding metadata

const groundingMetadata = result.response.candidates?.[0]?.groundingMetadata;

// REQUIRED - display Google Search suggestions

// (renderedContent contains HTML and CSS for the search widget)

const renderedContent = groundingMetadata?.searchEntryPoint?.renderedContent;

if (renderedContent) {

// TODO(developer): render this HTML and CSS in the UI

}

// REQUIRED - display sources

const groundingChunks = groundingMetadata?.groundingChunks;

if (groundingChunks) {

for (const chunk of groundingChunks) {

const title = chunk.web?.title; // for example, "uefa.com"

const uri = chunk.web?.uri; // for example, "https://vertexaisearch.cloud.google.com..."

// TODO(developer): show sources in the UI

}

}

Dart

// ...

// Get the model's response

final text = response.text;

// Get the grounding metadata

final groundingMetadata = response.candidates.first.groundingMetadata;

// REQUIRED - display Google Search suggestions

// (renderedContent contains HTML and CSS for the search widget)

final renderedContent = groundingMetadata?.searchEntryPoint?.renderedContent;

if (renderedContent != null) {

// TODO(developer): Display Google Search suggestions using a WebView

}

// REQUIRED - display sources

final groundingChunks = groundingMetadata?.groundingChunks;

if (groundingChunks != null) {

for (var chunk in groundingChunks) {

final title = chunk.web?.title; // for example, "uefa.com"

final uri = chunk.web?.uri; // for example, "https://vertexaisearch.cloud.google.com..."

// TODO(developer): show sources in the UI

}

}

Einheit

// ...

// Get the model's response

var text = response.Text;

// Get the grounding metadata

var groundingMetadata = response.Candidates.First().GroundingMetadata.Value;

// REQUIRED - display Google Search suggestions

// (renderedContent contains HTML and CSS for the search widget)

if (groundingMetadata.SearchEntryPoint.HasValue) {

var renderedContent = groundingMetadata.SearchEntryPoint.Value.RenderedContent;

// TODO(developer): Display Google Search suggestions using a WebView

}

// REQUIRED - display sources

foreach(GroundingChunk chunk in groundingMetadata.GroundingChunks) {

var title = chunk.Web.Value.Title; // for example, "uefa.com"

var uri = chunk.Web.Value.Uri; // for example, "https://vertexaisearch.cloud.google.com..."

// TODO(developer): show sources in the UI

}

Fundierte Ergebnisse und KI-Monitoring in der Firebase-Konsole

Wenn Sie KI-Monitoring in der Firebase-Konsole aktiviert haben, werden Antworten in Cloud Logging gespeichert. Standardmäßig haben diese Daten eine Aufbewahrungsdauer von 30 Tagen.

Es liegt in Ihrer Verantwortung, dafür zu sorgen, dass diese Aufbewahrungsdauer oder ein von Ihnen festgelegter benutzerdefinierter Zeitraum vollständig mit Ihrem spezifischen Anwendungsfall und allen zusätzlichen Compliance-Anforderungen für Ihren ausgewählten Gemini API-Bereitsteller übereinstimmt:Gemini Developer API oder Vertex AI Gemini API (siehe Abschnitt Nutzungsbedingungen des Dienstes in den dienstspezifischen Nutzungsbedingungen). Möglicherweise müssen Sie den Aufbewahrungszeitraum in Cloud Logging anpassen, um diese Anforderungen zu erfüllen.

Preise und Limits

Sehen Sie sich die Preise, die Modellverfügbarkeit und die Limits für Fundierung mit